Эксперт объяснил, почему ИИ в одних задачах превосходит человека, а в других делает дикие ошибки

Ученые из Университета Брауна разработали инструмент, который может объяснить, как работают модели ИИ, классифицирующие изображения, работают и почему они ошибаются. Такие инструменты необходимы и для исследования систем ИИ и для их контроля и повышения надежности.

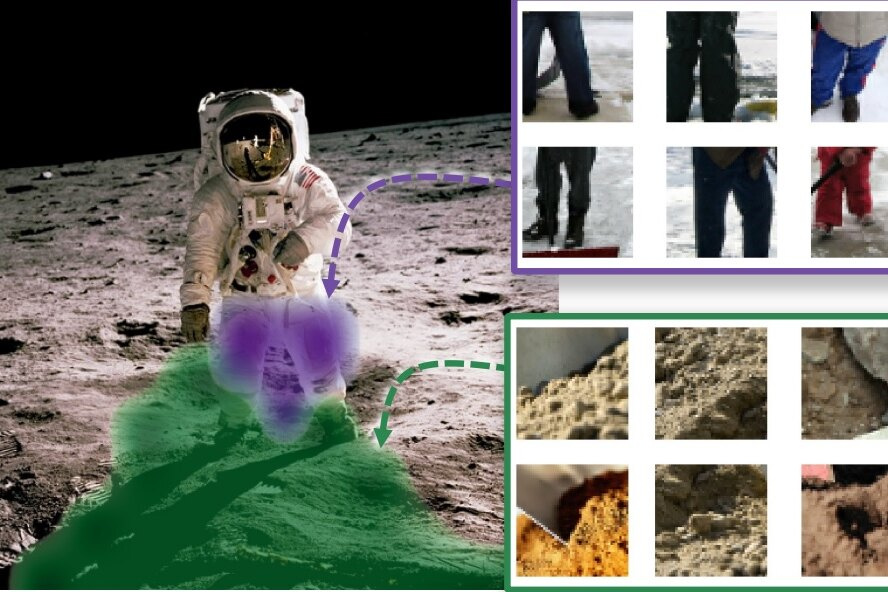

Почему системы искусственного интеллекта могут превзойти человека в некоторых визуальных задачах, например, в распознавании лиц, но допускают вопиющие ошибки в других — например, про изображение астронавта, говорят, что это — лопата?

К

ак и человеческий мозг, системы искусственного интеллекта опираются на определенные стратегии обработки и классификации изображений. И, как и в случае с человеческим мозгом, мало что известно о точной природе этих процессов. Ученые из Института науки о мозге Карни при Университете Брауна разбираются с тем, как обе эти системы работают, и добились определенного прогресса в понимании обеих систем.

«И человеческий мозг, и глубокие нейронные сети, на которых основаны системы искусственного интеллекта, называют черными ящиками, потому что мы не знаем точно, что происходит внутри», — говорит Томас Серр, профессор когнитивных, лингвистических и психологических наук и информатики в Брауне. — «Работа, которую мы проводим в Центре вычислительной науки о мозге Карни, направлена на то, чтобы понять и охарактеризовать механизмы мозга, связанные с обучением, зрением и другими видами деятельности, и выявить сходства и различия процессе в мозге с системами искусственного интеллекта».

Глубокие нейронные сети используют алгоритмы обучения для обработки изображений, говорит Серр. Они обучаются на массивных наборах данных, таких как ImageNet, который содержит более миллиона изображений, взятых из Интернета и разделенных на тысячи категорий. Обучение в основном заключается в подаче данных в систему ИИ, пояснил он.

«Мы не указываем системам ИИ, как обрабатывать изображения — например, какую информацию извлекать из изображений, чтобы иметь возможность их классифицировать», — говорит Серр. — «Система ИИ находит свою собственную стратегию. Затем ученые оценивают точность работы ИИ после обучения, например, система достигает 90% точности при различении тысячи категорий изображений».

Серр и его коллеги из Университета Брауна разрабатывают инструмент, который позволяет пользователям приоткрыть крышку «черного ящика» глубоких нейронных сетей и выяснить, какие стратегии используют системы искусственного интеллекта для обработки изображений.

Проект, названный CRAFT — Concept Recursive Activation FacTorization for Explainability — был совместным проектом с Институтом искусственного и естественного интеллекта Тулузы. В этом месяце он был представлен на конференции IEEE/CVF по компьютерному зрению и распознаванию образов в Ванкувере, Канада.

Серр рассказал о том, как CRAFT анализирует процесс, с помощью которого ИИ «видит» изображения, и объяснил исключительную важность понимания того, чем система компьютерного зрения отличается от человеческой.

Томас Серр ответил на вопросы Techxplore.com.