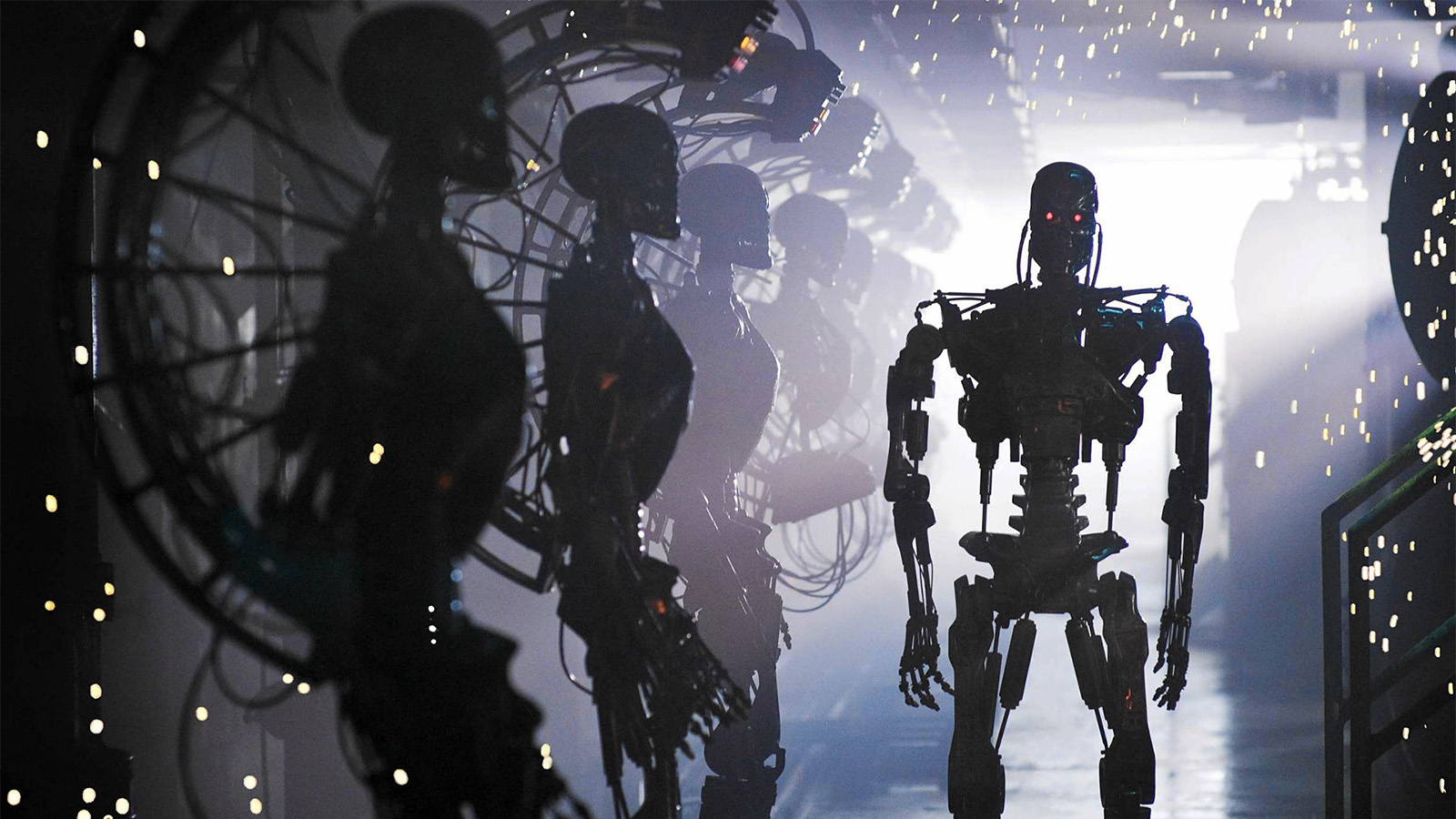

Скайнет в эпоху киберпанка: книга о сверхразуме, написанная в соавторстве с ИИ

Количество разума во Вселенной удваивается каждые 18 месяцев, что означает, что нейросети и модели LLM становятся все более мощными и масштабируемыми, говорится в книге кофаундеров Web-3 платформы Bithoven Антона Платунова и Андрея Глебова «Скайнет в эпоху киберпанка. Теория сверхразума и вызовы перед человечеством в XXI веке». Соавтором книги, вышедшей в мае на Литрес, стал искусственный интеллект языковой модели GPT-4. Он создавал диалоги и участвовал в формировании сюжетной линии. Forbes Life публикует отрывок из произведения.

Глава 9. Тайны технологии LLM: Теория зарождения сверхразума

Теория разума (ToM), или способность приписывать ненаблюдаемые психические состояния другим, занимает центральное место в человеческих социальных взаимодействиях, общении, сопереживании, самосознании и морали. Мы применяем классические задачи на ложные убеждения, широко используемые для тестирования ToM на людях, для нескольких языковых моделей без каких-либо примеров или предварительного обучения. Наши результаты показывают, что модели, опубликованные до 2022 года, практически не способны решать задачи ToM. Тем не менее, версия GPT-3 (davinci-002) от января 2022 года решила 70 % задач ToM, что сопоставимо с показателями семилетних детей. Более того, его версия от ноября 2022 года (davinci-003) решила 93 % задач ToM, что сопоставимо с показателями девятилетних детей.

Теория разума (ToM), или способность приписывать ненаблюдаемые психические состояния другим, занимает центральное место в человеческих социальных взаимодействиях, общении, сопереживании, самосознании и морали. Мы применяем классические задачи на ложные убеждения, широко используемые для тестирования ToM на людях, для нескольких языковых моделей без каких-либо примеров или предварительного обучения. Наши результаты показывают, что модели, опубликованные до 2022 года, практически не способны решать задачи ToM. Тем не менее, версия GPT-3 (davinci-002) от января 2022 года решила 70 % задач ToM, что сопоставимо с показателями семилетних детей. Более того, его версия от ноября 2022 года (davinci-003) решила 93 % задач ToM, что сопоставимо с показателями девятилетних детей.

Скорость внедрения и развития ИИ на самых разных уровнях просто поражает. Только недавно вышла модель GPT-4, обученная на 500 миллиардах параметров, по сравнению со 175 миллиардами параметров у GPT-3, как уже говорят о выходе новой модели GPT-5, опрометчиво заявляя о том, что эта модель достигнет уровня AGI.

AGI (artificial general intelligence) – это концепция «общего искусственного интеллекта», называемого также «сильным ИИ», которая относится к способности ИИ понимать и изучать любую задачу или идею, которые могут обдумать и осознать люди. Другими словами, ИИ, достигший ОИИ, может быть неотличим от человека по своим интеллектуальным возможностям. Это делает подобные заявления довольно опасными, учитывая все возможности, которые может предоставить AGI. В позитивном смысле это может значительно повысить производительность различных процессов с поддержкой ИИ, ускорив работу людей и избавив от монотонной рутинной и утомительной работы. В то же время наделение ИИ такой мощью может иметь непредвиденные последствия, о которых люди просто еще не подумали и не осознали. Это не означает, что апокалипсис роботов неизбежен, но, безусловно, вызывает много вопросов о том, какими могут быть негативные последствия ОИИ.

Это приводит к осознанию необходимости более глубокого изучения подобных систем ИИ и исследований. Ведь наш разум будет просто не способен осознать мышление AGI, как муравью не понять ход мыслей и мышление человека. Если заглянуть на открытый отчет исследований GPT-4 от Microsoft, то процесс зарождения AGI становится очевидным: «GPT-4 поразительно близка к производительности на уровне человека и часто значительно превосходит предыдущие модели, такие как ChatGPT. Учитывая широту и глубину возможностейGPT-4, мы считаем, что его можно разумно рассматривать как раннюю (но все еще неполную) версию системы общего искусственного интеллекта (AGI). В нашем исследовании GPT-4 мы уделяем особое внимание выявлению его ограничений и обсуждаем предстоящие проблемы, связанные с продвижением к более глубоким и всесторонним версиям ОИИ, включая возможную потребность в следовании новой парадигме, которая выходит за рамки предсказания следующего слова», – сказано в открытом отчете Microsoft.

То есть уже сейчас не предполагаются, а опытно фиксируются зачатки разума общего искусственного интеллекта. Человеку трудно и даже невозможно представить на что будет способна GPT-5. «Новая версия закона Мура, которая может начать действовать в ближайшее время: количество разума во Вселенной удваивается каждые 18 месяцев», – высказывание, данное Сэмом Альтманом (гендиром компании OpenAI, создавшей ChatGPT) для последствий происходящей революции, символом которой стал ChatGPT.

А теперь давайте разберемся с основами нейросетей. Нейронные сети – это модели машинного обучения, которые вдохновлены биологическими нейронными сетями. Они состоят из слоев, каждый из которых содержит узлы, называемые нейронами. Нейроны внутри одного слоя связаны с нейронами следующего слоя, и каждая связь имеет свою значимость и приоритет. В процессе обучения нейросети, зависимости значимостей и приоритеты изменяются для минимизации ошибки предсказания контекста. Теперь перейдем к моделям LLM (Large Language Models) и их связи с законом Мура. Закон Мура был сформулирован в 1965 году и утверждал, что количество транзисторов на интегральной схеме будет удваиваться примерно каждые два года. Новая версия закона Мура, о которой заявил основатель Open AI, говорит о том, что количество разума во Вселенной удваивается каждые 18 месяцев. Это утверждение относится к экспоненциальному росту производительности и масштабирования алгоритмов машинного обучения, в частности, к моделям LLM. Модели LLM, такие как GPT-4, тренируются на огромных объемах текстовых данных. Они учатся предсказывать следующее слово в последовательности на основе контекста, что позволяет им генерировать связные и осмысленные тексты. Обучение и масштабирование моделей LLM требует больших вычислительных ресурсов и разработки продвинутых алгоритмов оптимизации.