«Власти смогут «хакнуть» людей»: глава Huawei и автор Sapiens поспорили об опасности искусственного интеллекта

Развитие технологий приведет к тому, что государства получат возможность «хакнуть» людей, как сейчас делают с компьютерами и смартфонами, предупреждает автор бестселлера Sapiens Юваль Харари. С ним не согласен основатель Huawei, который уверен, что искусственный интеллект не так опасен, как атомная бомба.

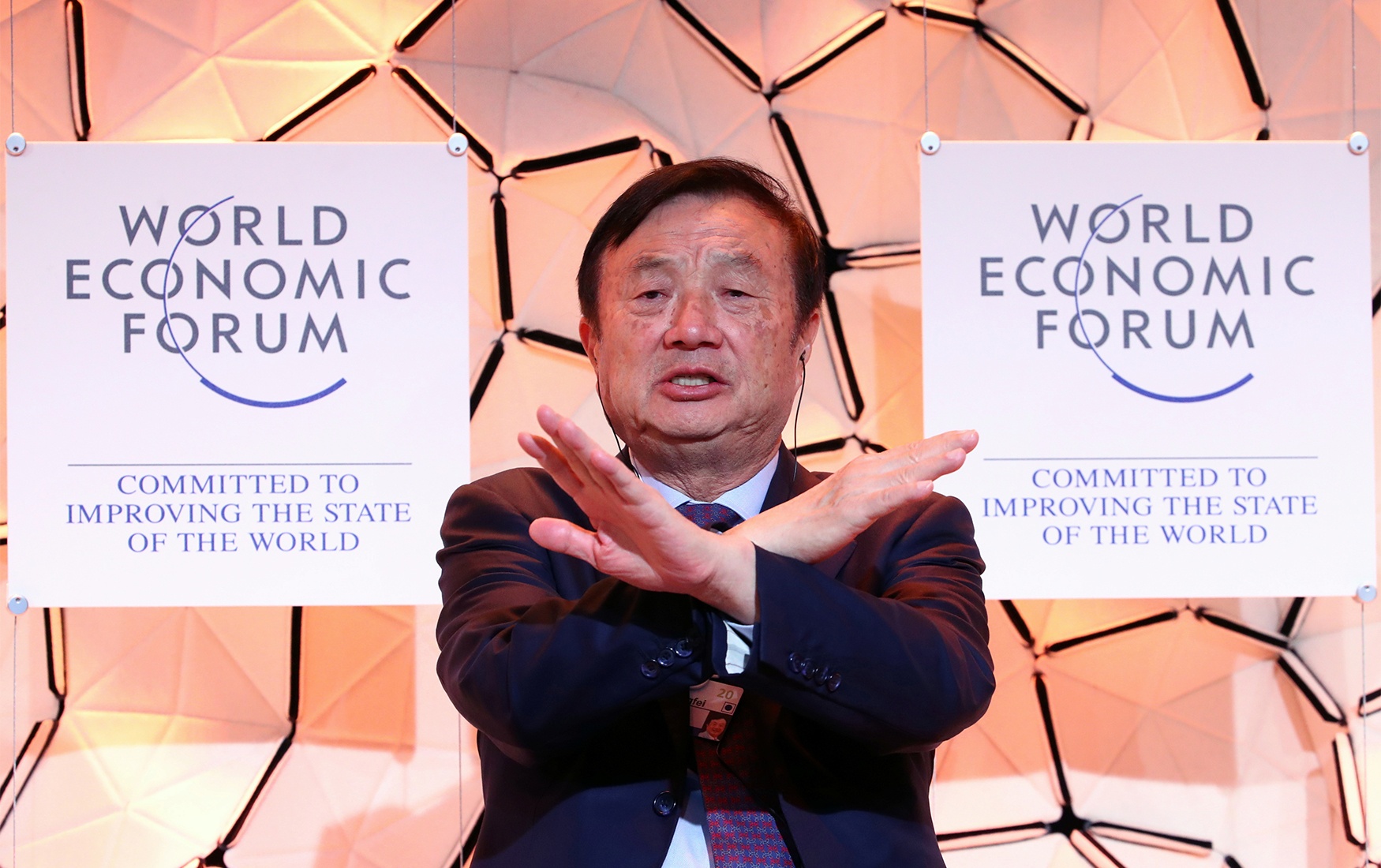

Основатель и генеральный директор Huawei Жэнь Чжэнфэй, занимающий 276-е место в списке китайских миллиардеров по версии Forbes, и автор бестселлера «Sapiens. Краткая история человечества» Юваль Ной Харари поспорили о технологической гонке вооружений на форуме в Давосе. Forbes пересказывает основные тезисы этого диалога.

Юваль Харари

Технологическая гонка вооружений может привести к появлению «информационных колоний». Может повториться ситуация, которая сложилась в XIX веке: лидеры индустрии снова будут управлять миром экономически и политически. Современная гонка вооружений — это империалистическая гонка вооружений. Если у тебя есть все данные о стране, не нужно отправлять туда солдат. Власти смогут «хакнуть» людей, имея достаточно развитые биотехнологии. Много говорят о взломе компьютеров, телефонов или банковских счетов, но реальный вопрос — это взлом человека. Если у вас достаточно данных обо мне, достаточно биологических навыков и есть сильная технология, вы сможете взломать мое тело, мой мозг, мою жизнь… Вы можете достигнуть этапа, когда будете знать меня лучше, чем я сам. Мы близки к точке невозврата. И мы не имеем понятия, что произойдет после.