Этика беспилотников: как нельзя кодировать мораль

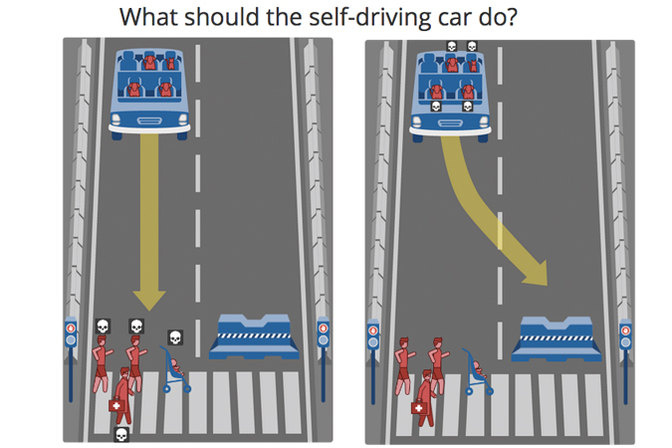

Кого должен сбить беспилотный автомобиль в безвыходной аварийной ситуации - пожилого человека или беременную женщину? Ребенка с собакой или кого-то похожего на воришку? Или врезаться в бетонное ограждение, чтобы спасти пешеходов, но рискнуть пассажиром? Примерно такие вопросы возникают в публичных обсуждениях, когда речь заходит об этике беспилотных автомобилей. Но давайте разберемся, что на самом деле делают, когда пытаются научить беспилотник морали.

Аморальная машина

Вопросы вроде - "кто важнее - человек или животное, доктор или вор, беременная женщина или пожилой мужчина?” - типичные для игры в моральную машину, которую создали на базе медиа-лаборатории Массачусетского технологического института.

“Моральная машина” - один из самых известных на сегодняшний день проектов, посвященных решению этических вопросов. Его разработала команда исследователей из разных дисциплин, университетов и стран еще в 2015 году. С тех пор тест был переведен на 10 языков, и его прошли миллионы людей по всему миру. Идея этого проекта представляет собой попытку решить вопросы этики беспилотных автомобилей с помощью больших данных. То есть предполагалось, что чем больше людей решат эти задачи, тем больше шансов у разработчиков беспилотников сделать их машины действительно этичными.